Ética y Robótica: Los Desafíos del Mañana

Un Territorio Inexplorado

A medida que los robots se vuelven más autónomos, inteligentes y omnipresentes en nuestra sociedad, nos enfrentamos a un territorio ético en gran parte inexplorado. Las máquinas que estamos creando hoy plantean preguntas fundamentales sobre responsabilidad, privacidad, autonomía y los límites de la relación humano-máquina.

A medida que los robots se vuelven más autónomos e inteligentes, surgen importantes cuestiones éticas. ¿Cómo programamos valores morales en máquinas? ¿Quién es responsable cuando un robot comete un error? ¿Deberían tener los robots algún tipo de derechos? Este artículo explora los dilemas éticos que enfrentamos en la era de la robótica avanzada.

Dilemas Éticos Fundamentales

1. Responsabilidad y Toma de Decisiones Autónoma

Uno de los desafíos éticos más apremiantes surge cuando los robots toman decisiones de forma autónoma:

- La cadena de responsabilidad: ¿Quién es responsable cuando un robot autónomo causa daño? ¿El fabricante, el programador, el usuario o el propio robot?

- Decisiones trágicas: ¿Cómo programamos robots para tomar decisiones en situaciones tipo "dilema del tranvía", donde cualquier acción causará algún tipo de daño?

- Transparencia algorítmica: ¿Deberían ser comprensibles los procesos de toma de decisiones de los robots, o es aceptable el uso de "cajas negras" si los resultados son beneficiosos?

Representación conceptual de un robot enfrentando un dilema ético.

2. Privacidad y Vigilancia

Los robots modernos están equipados con sensores avanzados que recopilan enormes cantidades de datos:

- Vigilancia doméstica: Los robots domésticos pueden monitorear continuamente nuestros hogares y hábitos. ¿Hasta qué punto esta vigilancia es aceptable?

- Uso de datos personales: ¿Cómo se deben manejar los datos sensibles recopilados por robots en entornos médicos, educativos o domésticos?

- Derecho al olvido: ¿Deberían los robots estar programados para "olvidar" cierta información después de un tiempo, similar a la memoria humana?

3. El Espectro de la Autonomía

La creciente autonomía de los robots plantea cuestiones sobre los límites que deberíamos establecer:

- Control humano significativo: ¿Qué niveles de autonomía son aceptables en diferentes contextos? ¿Siempre debe existir una "persona en el bucle"?

- Robots militares: ¿Deberíamos permitir que los sistemas de armas autónomos tomen decisiones sobre vida o muerte sin intervención humana?

- Autodeterminación: Si desarrollamos robots con capacidades cognitivas avanzadas, ¿deberían tener algún grado de autodeterminación?

4. Impacto Social y Económico

La integración masiva de robots en la sociedad tendrá profundas implicaciones:

- Desplazamiento laboral: ¿Cómo gestionamos la transición hacia una economía altamente automatizada? ¿Qué responsabilidad ética tienen las empresas que implementan automatización a gran escala?

- Desigualdad tecnológica: ¿Cómo evitamos que la robótica aumente las brechas sociales entre quienes tienen acceso a estas tecnologías y quienes no?

- Dependencia: ¿Qué grado de dependencia de los sistemas robóticos es saludable para una sociedad?

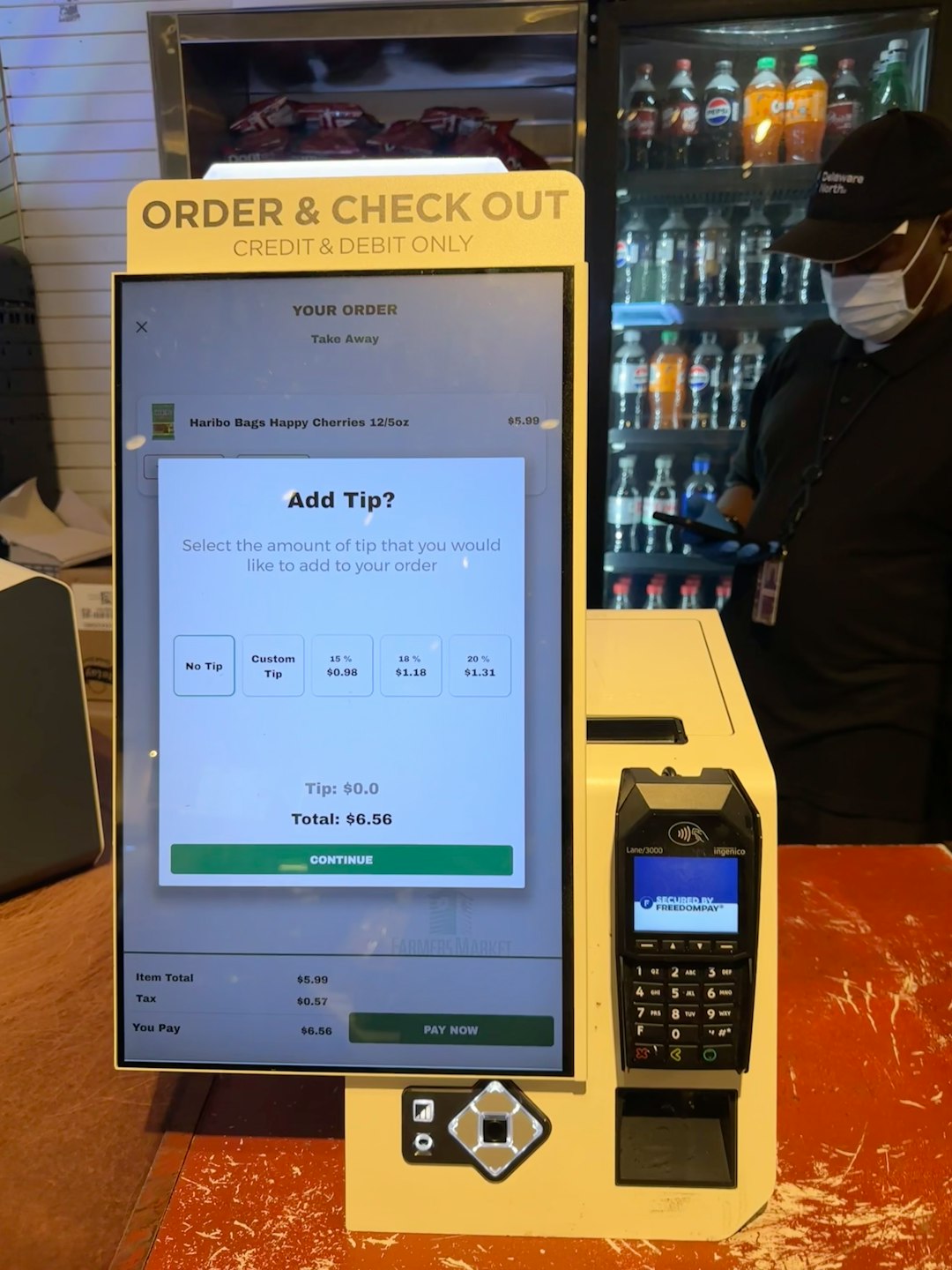

La robotización plantea importantes cuestiones sobre el futuro del trabajo humano.

Enfoques para la Ética Robótica

Diversos actores están proponiendo marcos para abordar estos desafíos éticos:

1. Regulación y Gobernanza

Los gobiernos y organismos internacionales están comenzando a desarrollar marcos regulatorios:

- La Unión Europea ha propuesto un marco legal para la IA y la robótica que incluye requisitos de transparencia, robustez y supervisión humana.

- La ISO ha desarrollado estándares específicos para la seguridad de los robots, como la ISO/TS 15066 para robots colaborativos.

- Países como Corea del Sur y Japón están pioneros en la creación de "cartas de derechos" para robots.

2. Ética por Diseño

Muchos investigadores abogan por incorporar consideraciones éticas desde las primeras etapas del diseño:

- Valores alineados: Diseñar robots cuyos objetivos y valores estén alineados con los humanos.

- Explicabilidad: Crear sistemas cuyas decisiones puedan ser entendidas por los usuarios.

- Corregibilidad: Asegurar que los robots puedan ser corregidos si desarrollan comportamientos no deseados.

3. Códigos Éticos y Directrices

Organizaciones profesionales y grupos de investigación han propuesto varios conjuntos de principios:

- Las "Leyes de la Robótica" de Asimov, aunque ficticias, han influido en muchos debates éticos.

- El Instituto de Ingenieros Eléctricos y Electrónicos (IEEE) ha desarrollado la "Ethically Aligned Design", una guía para el desarrollo ético de IA y sistemas autónomos.

- El principio EPSRC para diseñadores de robots: "Los robots son productos. Deben ser diseñados para ser seguros, fiables y cumplir las leyes, incluidas las de privacidad."

Casos de Estudio y Dilemas Concretos

Caso 1: Vehículos Autónomos y Decisiones de Riesgo

Los vehículos autónomos representan uno de los campos donde los dilemas éticos son más evidentes:

Imaginemos un escenario inevitable de accidente donde un vehículo autónomo debe elegir entre diferentes trayectorias, cada una con distintas probabilidades de daño para diferentes grupos de personas. ¿Debería programarse para minimizar el número total de víctimas? ¿Para proteger a sus ocupantes a toda costa? ¿Para tratar a todos por igual independientemente de la edad o condición?

El experimento "Moral Machine" del MIT ha recopilado millones de decisiones humanas sobre estos dilemas, revelando diferencias culturales significativas en las preferencias morales, lo que complica aún más la creación de un estándar universal.

Caso 2: Robots de Cuidado y Engaño Ético

Los robots diseñados para el cuidado de personas mayores o con demencia plantean cuestiones sobre el engaño ético:

Robots como PARO (con forma de foca) se utilizan en terapias para pacientes con demencia, creando un vínculo emocional que, aunque beneficioso terapéuticamente, se basa en una falsa percepción del robot como ser sensible. ¿Es ético fomentar este tipo de engaño si mejora el bienestar del paciente? ¿Qué ocurre si el paciente desarrolla un apego excesivo o si el robot sustituye la interacción humana?

Los robots de cuidado plantean dilemas sobre el engaño ético y los vínculos emocionales.

Caso 3: Robots Autónomos en Zonas de Conflicto

Los sistemas robóticos militares presentan algunos de los dilemas éticos más graves:

Aunque las Naciones Unidas ha debatido prohibiciones preventivas de sistemas de armas letales autónomas, el desarrollo continúa. Estos sistemas plantean cuestiones sobre la proporcionalidad, discriminación entre combatientes y civiles, y la fundamental "dignidad humana" de morir por decisión de una máquina en lugar de un humano. La campaña "Stop Killer Robots" argumenta que ningún algoritmo debería tomar decisiones sobre vida o muerte.

Hacia un Futuro Ético con los Robots

1. Educación y Alfabetización Tecnológica

Para abordar estos desafíos éticos, necesitamos una sociedad informada:

- Educación temprana sobre ética tecnológica y pensamiento crítico

- Formación interdisciplinaria que combine ingeniería con humanidades

- Mayor transparencia sobre las capacidades y limitaciones reales de los sistemas robóticos

2. Participación Diversa e Inclusiva

Las decisiones sobre ética robótica no pueden dejarse solo a los tecnólogos:

- Inclusión de diversas voces en el diseño y regulación de sistemas robóticos

- Consideración de perspectivas culturales diferentes sobre autonomía, privacidad y responsabilidad

- Participación activa de los usuarios finales en la definición de estándares éticos

3. Equilibrio entre Innovación y Precaución

Necesitamos encontrar un camino que permita avanzar sin ignorar los riesgos:

- Adopción del principio de precaución en áreas de alto riesgo

- Establecimiento de "zonas de prueba" reguladas para innovaciones robóticas avanzadas

- Evaluaciones de impacto ético obligatorias para sistemas robóticos de alto riesgo

Conclusión: Una Ética para la Era de los Robots

La robótica avanzada nos obliga a reexaminar y tal vez ampliar nuestros marcos éticos tradicionales. No estamos simplemente aplicando ética a una nueva tecnología; estamos desarrollando una nueva ética para una era en la que compartiremos nuestro mundo con entidades artificiales cada vez más autónomas e inteligentes.

Las decisiones que tomemos hoy sobre ética robótica no solo determinarán qué tecnologías desarrollamos, sino también qué tipo de sociedad construimos. ¿Utilizaremos la robótica para crear un mundo más justo, seguro y próspero para todos? ¿O permitiremos que estas tecnologías amplifiquen desigualdades existentes y creen nuevos riesgos?

El futuro ético de la robótica no es algo que simplemente ocurrirá; es algo que debemos diseñar activamente, a través de un diálogo abierto, inclusivo y continuo que involucre a toda la sociedad. Como dijo una vez el científico informático Joseph Weizenbaum: "La pregunta no es tanto si las máquinas pueden pensar, sino si los humanos pueden hacerlo de manera suficientemente cuidadosa sobre cómo usamos las máquinas."